MiniMax M2.7: La IA Open-Weight que Desafía a Claude Opus y Redefine la Economía de las Startups

El panorama de la inteligencia artificial ha dado un giro sísmico con la llegada de MiniMax M2.7. En un mercado dominado por gigantes como Anthropic y OpenAI, la aparición de un modelo capaz de igualar el rendimiento de Claude Opus 4.6 pero con un costo operativo hasta 50 veces menor no es solo una noticia técnica; es un cambio de paradigma para cualquier desarrollador, founder o empresa que dependa de modelos de lenguaje a gran escala. MiniMax M2.7 no solo ofrece potencia, sino que democratiza el acceso a la capacidad de cómputo de nivel «frontier» mediante una arquitectura altamente eficiente y una filosofía de pesos abiertos que permite su implementación local.

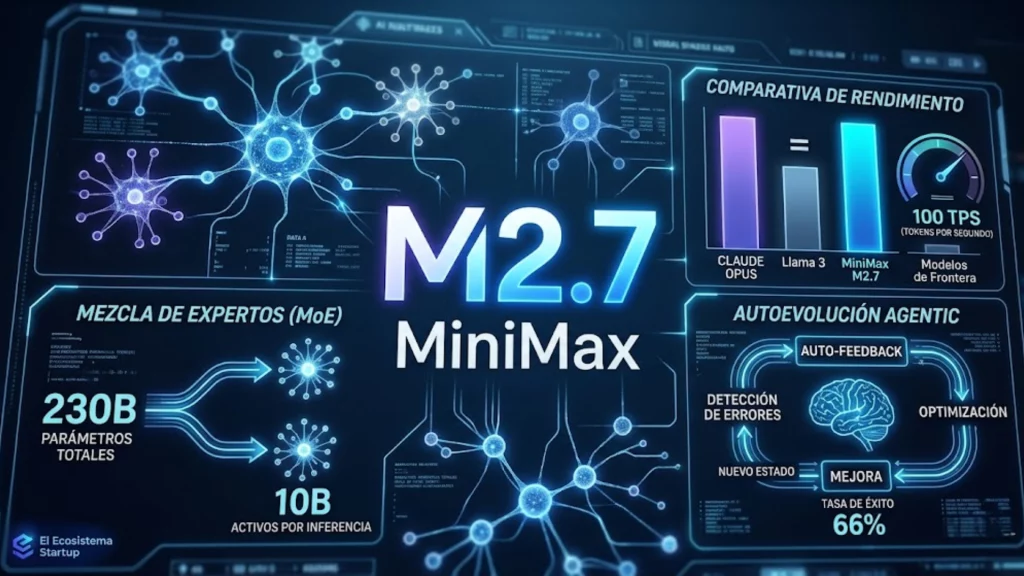

Para entender el impacto de MiniMax M2.7, es necesario analizar el contexto de su origen. MiniMax es una startup china que ha logrado posicionarse en la vanguardia de la IA optimizando cada parámetro de sus modelos. Ante las restricciones globales de hardware, los laboratorios de este ecosistema han perfeccionado el arte de hacer más con menos. M2.7 es el resultado de esa evolución: un modelo de 230 mil millones de parámetros totales que, gracias a su arquitectura de Mezcla de Expertos (Mixture of Experts – MoE), solo activa 10 mil millones de parámetros durante la inferencia. Esto permite que el modelo sea increíblemente rápido y, sobre todo, extremadamente barato de ejecutar sin sacrificar la profundidad del conocimiento.

La arquitectura Mixture of Experts es el corazón de la eficiencia de MiniMax M2.7. Al no tener que activar la totalidad de sus parámetros para cada consulta, el modelo reduce drásticamente la demanda de memoria y el tiempo de procesamiento. En términos prácticos, la versión Highspeed de este modelo alcanza los 100 tokens por segundo, superando en velocidad a la mayoría de sus competidores directos de código cerrado. Para una startup que procesa millones de tokens diariamente, esta diferencia se traduce en una mejora directa de los márgenes de beneficio. Si actualmente una empresa gasta una suma considerable en APIs de Claude o GPT, la migración a M2.7 podría reducir esa factura a una fracción mínima, permitiendo reinvertir ese capital en otras áreas de crecimiento.

En cuanto a su rendimiento comparativo, los benchmarks sitúan a MiniMax M2.7 en la liga de los grandes. En pruebas de ingeniería de software autónoma como SWE-Pro, el modelo ha alcanzado una tasa de resolución del 56.22%, empatando con versiones avanzadas de GPT-5.3-Codex. En el ámbito del machine learning práctico, el benchmark MLE-Bench Lite le otorga una eficacia del 66.6%, igualando a Gemini 3.1. Estas cifras demuestran que no estamos ante un modelo «low-cost» de menor calidad, sino ante una herramienta de alto rendimiento diseñada para tareas complejas de codificación, razonamiento lógico y procesamiento de datos masivos.

Uno de los diferenciadores más críticos y menos comunes en otros modelos es la capacidad de «autoevolución» o auto-mejora autónoma. MiniMax M2.7 está diseñado bajo un framework agentic que le permite gestionar su propia memoria a corto plazo, generar feedback sobre sus propios errores y aplicar rondas de optimización internas sin necesidad de intervención humana constante. Durante las pruebas de desarrollo, el modelo participó de forma autónoma en competiciones de machine learning, logrando medallas de oro con una tasa de éxito impresionante. Esta funcionalidad permite que, al integrarlo en flujos de trabajo empresariales, el modelo no solo ejecute tareas, sino que aprenda y refine sus procesos de resolución de problemas en tiempo real.

La liberación de los pesos del modelo (open-weight) representa una oportunidad estratégica. A diferencia de los modelos cerrados, donde el usuario depende totalmente de la infraestructura y precios del proveedor, disponer de los pesos permite que MiniMax M2.7 sea desplegado en servidores propios o en nubes privadas. Esto es fundamental para empresas que manejan datos sensibles o que operan en sectores con regulaciones estrictas de privacidad. El modelo es compatible con frameworks populares como vLLM y Transformers, y puede encontrarse en repositorios como Hugging Face, facilitando su integración técnica en stacks de desarrollo ya existentes.

Comparado con otros modelos de código abierto como Llama de Meta, MiniMax M2.7 presenta ventajas específicas en tareas de codificación agentic. Mientras que Llama es un excelente generalista, sus modelos más grandes requieren una infraestructura pesada y costosa. Por su parte, MiniMax, al ser MoE nativo, ofrece una relación potencia-consumo más equilibrada para aplicaciones específicas de producción. Frente a DeepSeek, otro competidor fuerte en programación, MiniMax destaca por su capa de auto-optimización, lo que lo hace más adecuado para procesos que requieren una supervisión mínima.

La implementación de MiniMax M2.7 en el ecosistema de una startup debe ser vista desde tres ángulos: ahorro, velocidad y autonomía. El ahorro de costos es el beneficio más inmediato. Al utilizar la API Highspeed a través de plataformas como Atlas Cloud, los costos de inferencia se desploman. Para aquellas organizaciones que ya superan los umbrales de gasto críticos en modelos tradicionales, el retorno de inversión al migrar a M2.7 es casi instantáneo. La velocidad de 100 tokens por segundo mejora la experiencia del usuario final en aplicaciones de chat, generación de contenido en tiempo real y herramientas de productividad.

Sin embargo, la verdadera joya de la corona es la autonomía agentic. Al permitir flujos de trabajo donde el modelo puede detectar y reparar bugs en producción de forma independiente (con una resolución promedio de 3 minutos en pruebas técnicas), las empresas pueden liberar a sus equipos humanos de tareas repetitivas y de mantenimiento básico. Esto permite que el talento humano se enfoque en la innovación y la estrategia, mientras que la infraestructura de IA se encarga de la ejecución y el refinamiento operativo.

Es importante mencionar las consideraciones de licencia. MiniMax M2.7 permite el uso comercial, lo cual es vital para el sector empresarial. No obstante, al ser un modelo desarrollado en China, las empresas deben realizar su debida diligencia en términos de cumplimiento y gobernanza de datos, asegurándose de que el despliegue cumpla con las políticas internas y locales. El hecho de que sea open-weight mitiga muchos de estos riesgos, ya que el control del modelo reside finalmente en quien lo aloja.

Al evaluar MiniMax M2.7 frente a Claude Opus, la pregunta para un CTO o un CEO ya no es cuál modelo es ligeramente más inteligente en un benchmark abstracto, sino cuál es más sostenible para el modelo de negocio. Claude Opus sigue siendo un referente de calidad y seguridad, pero su costo lo hace prohibitivo para aplicaciones de gran volumen donde el margen es estrecho. MiniMax M2.7 cierra esa brecha, ofreciendo una paridad funcional que hace que el costo de oportunidad de no probarlo sea demasiado alto.

Para los fundadores en regiones como España o Latinoamérica, donde el acceso al capital y a presupuestos de infraestructura suele ser más limitado que en Silicon Valley, MiniMax M2.7 actúa como un gran nivelador. Permite que equipos pequeños construyan productos con capacidades de inteligencia artificial que antes estaban reservadas para corporaciones con presupuestos multimillonarios. La democratización de la potencia de cómputo es el motor de la próxima ola de innovación en el software, y modelos como M2.7 son el combustible de esa transformación.

El futuro de la inteligencia artificial no solo se trata de modelos más grandes, sino de modelos más inteligentes en su funcionamiento. La arquitectura de Mixture of Experts y las capacidades de auto-mejora de MiniMax M2.7 son señales claras de hacia dónde se dirige la industria. Las empresas que logren integrar estos modelos eficientes hoy, tendrán una ventaja competitiva en costos y capacidad operativa que será difícil de superar por aquellos que sigan anclados exclusivamente en soluciones de API cerradas y costosas.

En la práctica, la adopción de MiniMax M2.7 puede comenzar de manera gradual. Un enfoque recomendado es auditar los gastos actuales en APIs de LLM y seleccionar flujos de trabajo no críticos para las primeras pruebas. Tareas como el resumen de tickets de soporte, la generación de borradores internos o el análisis de sentimientos son candidatos perfectos para validar el rendimiento del modelo en un entorno real. Una vez confirmada la estabilidad y la calidad de las respuestas, la migración de flujos críticos de código o motores de razonamiento puede realizarse con mayor confianza.

La disponibilidad del modelo en plataformas como Hugging Face y su compatibilidad con hardware estándar de GPU significan que la barrera técnica de entrada es mínima. Cualquier equipo con experiencia en despliegue de modelos de lenguaje puede tener una instancia de MiniMax M2.7 funcionando en cuestión de horas. Esta facilidad de despliegue, combinada con la reducción masiva de costos, posiciona a este modelo como una de las herramientas más valiosas en el arsenal de cualquier profesional de la IA y el crecimiento digital.

La guerra de los modelos de inteligencia artificial está pasando de una fase de descubrimiento a una de optimización económica. Durante los últimos años, el enfoque estuvo en qué podía hacer la IA; ahora, el enfoque está en cómo hacerlo de manera rentable y escalable. MiniMax M2.7 es la respuesta a esa necesidad del mercado. Es una herramienta diseñada para la producción, pensada para la eficiencia y abierta para la innovación.

Al observar la trayectoria de MiniMax y su serie de modelos M2, queda claro que su estrategia es la de un retador disruptivo. No intentan simplemente copiar lo que hacen OpenAI o Anthropic, sino superarlos en la arquitectura de costos y en la flexibilidad de uso. El hecho de igualar a Claude Opus, un modelo que ha sido alabado por su capacidad de razonamiento y matiz, demuestra que la brecha técnica entre los modelos cerrados y los modelos abiertos o de pesos abiertos se está cerrando a una velocidad vertiginosa.

Para los especialistas en SEO y redactores de contenido, la integración de MiniMax M2.7 ofrece una capacidad de generación de texto optimizado sin los límites de cuotas asfixiantes. La posibilidad de realizar miles de llamadas a la API para estructurar artículos, investigar palabras clave o generar metadatos a un costo marginal permite una escala de producción de contenido nunca antes vista. En el marketing digital de 2026, la eficiencia operativa es tan importante como la creatividad, y MiniMax M2.7 proporciona ambas.

Finalmente, el impacto de este modelo se extiende a la infraestructura global de la IA. La tendencia hacia modelos más pequeños pero más densos en conocimiento, asistidos por arquitecturas MoE, sugiere que el hardware del futuro será aprovechado de manera mucho más inteligente. Las startups ya no necesitan granjas de servidores masivas para correr modelos potentes; necesitan arquitecturas inteligentes que maximicen cada ciclo de GPU.

MiniMax M2.7 marca un hito en la historia de la IA aplicada. Representa la transición de la IA como un lujo experimental a la IA como una utilidad industrial accesible y potente. Para quienes buscan liderar en sus respectivos mercados, la integración de este modelo no es solo una opción técnica, sino un imperativo estratégico que definirá la viabilidad económica de sus proyectos en el corto y mediano plazo. La era de la IA de alta capacidad y bajo costo ha llegado, y tiene el nombre de MiniMax M2.7.

A medida que más desarrolladores comiencen a experimentar con sus pesos abiertos y a publicar sus propios benchmarks y casos de uso, la comunidad alrededor de MiniMax crecerá, cerrando la brecha de documentación que hoy podría ser una pequeña desventaja frente a modelos más establecidos. La agilidad para adoptar estas nuevas tecnologías será lo que separe a las empresas que escalan de aquellas que se quedan rezagadas bajo el peso de facturas operativas insostenibles.

El momento de actuar es ahora. Con la documentación disponible, los pesos en Hugging Face y la API lista para producción, MiniMax M2.7 está esperando ser el motor de la próxima generación de aplicaciones inteligentes. La promesa de una IA que iguala a los mejores del mundo de forma gratuita o a un costo despreciable ya es una realidad tangible. Explorar su potencial es el primer paso para dominar el nuevo ecosistema de la inteligencia artificial agentic y autónoma.