NVIDIA Y GOOGLE CLOUD: LA NUEVA ERA DE LA INFRAESTRUCTURA PARA IA GENERATIVA

La convergencia entre el hardware de procesamiento gráfico más avanzado del mundo y la infraestructura de nube más sofisticada ha alcanzado un nuevo hito. La reciente ampliación de la colaboración entre NVIDIA y Google Cloud no es simplemente un acuerdo corporativo más; representa un cambio tectónico en la capacidad de procesamiento disponible para desarrolladores, empresas y estados que buscan liderar la carrera de la inteligencia artificial generativa. Esta alianza estratégica busca democratizar el acceso a capacidades de cómputo que, hasta hace poco, eran exclusivas de un puñado de gigantes tecnológicos, permitiendo que la próxima generación de aplicaciones de IA sea más rápida, eficiente y escalable que nunca.

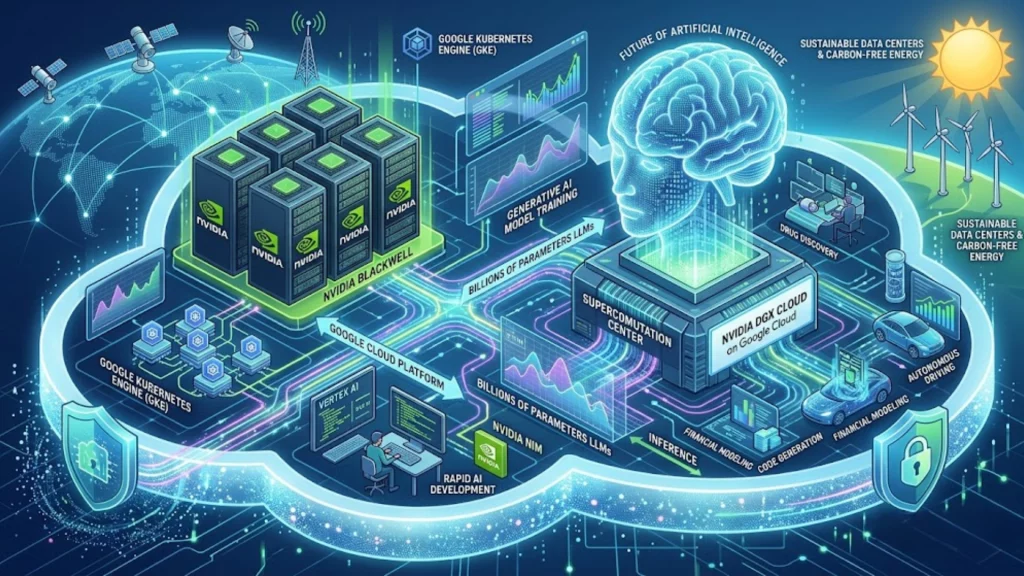

El núcleo de este anuncio reside en la integración de la arquitectura Blackwell de NVIDIA dentro de los ecosistemas de Google Cloud. Esta integración permite que las empresas aprovechen la potencia de las nuevas unidades de procesamiento gráfico (GPU) directamente desde la consola de Google, facilitando el entrenamiento de modelos de lenguaje de gran tamaño (LLM) que requieren billones de parámetros. La infraestructura de Google Cloud, conocida por su flexibilidad y su red de baja latencia, se convierte ahora en el lienzo perfecto para que el hardware de NVIDIA despliegue todo su potencial, reduciendo drásticamente los tiempos de entrenamiento y los costes operativos asociados a la inferencia de modelos complejos.

Para entender la magnitud de esta colaboración, es necesario desglosar qué significa realmente la arquitectura Blackwell en el contexto del cloud computing. NVIDIA ha diseñado esta plataforma no solo como un chip, sino como un sistema completo capaz de gestionar cargas de trabajo masivas. Al integrar estos sistemas en Google Cloud, se eliminan los cuellos de botella tradicionales entre el almacenamiento de datos y el procesamiento. Las empresas pueden ahora mover flujos de datos inmensos a través de las redes de Google directamente hacia las GPU de NVIDIA, logrando una sincronización que optimiza cada ciclo de reloj del procesador.

Uno de los puntos más destacados de esta expansión es el fortalecimiento de Google Kubernetes Engine (GKE) con las capacidades de las GPU de NVIDIA. GKE es el estándar de la industria para la gestión de contenedores, y su optimización para el hardware de NVIDIA permite que los desarrolladores despliequen aplicaciones de IA de manera resiliente. Esta combinación asegura que, si una carga de trabajo requiere de repente un aumento en la potencia de procesamiento, la infraestructura de Google Cloud pueda escalar automáticamente, utilizando la potencia de NVIDIA para mantener el rendimiento sin interrupciones. La capacidad de orquestar estos recursos a nivel global es lo que diferencia esta oferta de cualquier otra solución en el mercado actual.

La inteligencia artificial generativa ha dejado de ser una curiosidad de laboratorio para convertirse en una herramienta de producción crítica. Desde la creación de fármacos mediante el plegado de proteínas hasta la generación de código de software complejo, la demanda de potencia de cálculo es insaciable. La colaboración entre NVIDIA y Google Cloud responde a esta necesidad ofreciendo instancias de computación que están diseñadas específicamente para estas tareas. No se trata de servidores de propósito general adaptados, sino de una arquitectura pensada desde el primer transistor para maximizar el rendimiento por vatio, algo fundamental en un mundo donde la sostenibilidad energética de los centros de datos está bajo la lupa.

Vertex AI, la plataforma de desarrollo de IA de Google, también se beneficia profundamente de esta alianza. Al integrar las bibliotecas de software de NVIDIA, como los microservicios NVIDIA NIM, los desarrolladores pueden acelerar el ciclo de vida del desarrollo de modelos. Estos microservicios ofrecen contenedores optimizados que incluyen todo lo necesario para ejecutar modelos de IA de manera eficiente. Esto significa que un equipo de ciencia de datos puede pasar de una idea a un modelo en producción en una fracción del tiempo que se requería anteriormente, eliminando las complejidades de configurar entornos de hardware específicos.

La seguridad es otro pilar fundamental en esta expansión. En un entorno donde los datos corporativos son el activo más valioso, la infraestructura conjunta de NVIDIA y Google Cloud implementa capas de seguridad a nivel de hardware y software. La computación confidencial y el cifrado de datos en tránsito y en reposo se combinan con las capacidades de aislamiento de las GPU de NVIDIA para garantizar que el entrenamiento de modelos propietarios se realice en un entorno estanco. Esto es especialmente relevante para sectores altamente regulados como el financiero o el de la salud, donde la adopción de la IA ha sido más lenta debido a preocupaciones sobre la privacidad de la información.

El impacto económico de esta alianza no puede subestimarse. Al reducir las barreras de entrada para acceder a hardware de clase mundial, NVIDIA y Google Cloud están fomentando un ecosistema de innovación donde las startups pueden competir en igualdad de condiciones con las grandes corporaciones. El modelo de pago por uso de la nube permite que proyectos experimentales tengan acceso a las GPU Blackwell sin la necesidad de una inversión masiva en hardware físico. Esto acelera el «time-to-market» de nuevas soluciones basadas en IA, impulsando el crecimiento económico global y la competitividad tecnológica.

La infraestructura de Google Cloud se ha distinguido históricamente por su red global de fibra óptica y su capacidad de gestión de datos a gran escala. Al sumar la potencia de procesamiento paralelo de NVIDIA, se crea una simbiosis donde el dato y el proceso conviven en una proximidad física y lógica sin precedentes. Esto es vital para la inferencia en tiempo real, donde milisegundos de latencia pueden determinar el éxito o el fracaso de una aplicación, como en el caso de los vehículos autónomos o los sistemas de trading de alta frecuencia. La arquitectura distribuida de Google asegura que estos recursos de NVIDIA estén disponibles cerca de donde se generan los datos, minimizando los retardos de red.

A medida que avanzamos hacia una era donde la IA estará presente en cada interacción digital, la colaboración entre estas dos potencias asegura que la base tecnológica sea lo suficientemente robusta para soportar la carga. NVIDIA aporta la visión de un hardware que evoluciona a un ritmo vertiginoso, superando la Ley de Moore mediante innovaciones en el diseño de chips y la interconectividad. Por su parte, Google Cloud aporta la escala, la gestión de software y la accesibilidad necesarias para que esa potencia llegue a cualquier rincón del planeta. Juntos, están construyendo el sistema nervioso central de la economía digital moderna.

La integración de NVIDIA DGX Cloud en Google Cloud es otro componente esencial de esta asociación. DGX Cloud permite a las empresas acceder a un servicio de supercomputación de IA basado en la red, proporcionando la misma arquitectura que NVIDIA utiliza para sus propios desarrollos internos. Al estar disponible dentro de la infraestructura de Google, los usuarios pueden combinar la potencia bruta de las supercomputadoras DGX con los servicios de almacenamiento y análisis de datos de BigQuery, creando un flujo de trabajo unificado que abarca desde la ingesta de datos crudos hasta la implementación de modelos de IA altamente sofisticados.

El papel de los microservicios NVIDIA NIM dentro de Google Cloud merece una mención especial. Estos servicios están diseñados para cerrar la brecha entre los modelos de IA y las aplicaciones finales. Proporcionan APIs sencillas que permiten a los desarrolladores integrar capacidades de lenguaje, visión y voz en sus aplicaciones sin tener que preocuparse por la optimización del hardware subyacente. Esta capa de abstracción es crucial para la adopción masiva de la IA, ya que permite que programadores sin conocimientos profundos de arquitectura de GPU puedan crear aplicaciones potentes y eficientes, aprovechando la infraestructura optimizada que Google y NVIDIA han preconfigurado para ellos.

Mirando hacia el futuro, la expansión de esta colaboración sugiere que veremos una integración aún más estrecha entre el hardware de silicio y los sistemas operativos de la nube. La optimización ya no ocurre solo a nivel de software, sino que se está bajando al nivel del diseño del chip para que responda mejor a las demandas de los hiperescaladores como Google. Esta co-ingeniería garantiza que los próximos avances en inteligencia artificial no se vean frenados por limitaciones físicas, sino que encuentren siempre un camino despejado para su ejecución.

La sostenibilidad también ocupa un lugar central en el discurso de ambas empresas. La arquitectura Blackwell de NVIDIA promete una eficiencia energética significativamente mayor que sus predecesoras. Cuando esta eficiencia se combina con el compromiso de Google Cloud de operar con energía libre de carbono, el resultado es una infraestructura de IA que no solo es la más potente, sino también una de las más responsables desde el punto de vista medioambiental. Este es un factor decisivo para las corporaciones modernas que buscan cumplir con sus objetivos de sostenibilidad sin sacrificar su capacidad de innovación tecnológica.

La formación y el soporte técnico también forman parte de este ecosistema ampliado. Google Cloud y NVIDIA están colaborando en programas educativos y certificaciones para preparar a la próxima generación de ingenieros de IA. La complejidad de gestionar clústeres de GPU masivos requiere de un conocimiento especializado que ambas compañías están promoviendo activamente. Esto asegura que el despliegue de la infraestructura vaya acompañado de un capital humano capaz de extraer el máximo valor de estas herramientas, cerrando el círculo de la transformación digital.

La alianza entre NVIDIA y Google Cloud marca un punto de inflexión en la historia de la computación. No se trata solo de vender más chips o más espacio en la nube; se trata de establecer los cimientos sobre los cuales se construirá la inteligencia del mañana. La infraestructura de IA resultante de esta colaboración es un testimonio de lo que es posible cuando el liderazgo en hardware y el liderazgo en software se alinean con un propósito común: acelerar el progreso humano a través de la tecnología. Las empresas que sepan aprovechar esta infraestructura hoy serán las líderes indiscutibles en el panorama competitivo de la próxima década.

El despliegue de las GPU Blackwell en Google Cloud también abre la puerta a avances significativos en la computación cuántica simulada y el diseño industrial avanzado. Al utilizar la potencia de estos chips para simular sistemas complejos, los investigadores pueden acelerar el desarrollo de nuevos materiales y fuentes de energía limpia. La nube de Google proporciona el entorno colaborativo necesario para que científicos de todo el mundo accedan a estos recursos de NVIDIA, eliminando las fronteras geográficas en la investigación de vanguardia. La IA generativa es solo la punta del iceberg de lo que esta infraestructura puede lograr.

En última instancia, la colaboración reafirma la posición de Google Cloud como un destino preferente para las cargas de trabajo de IA más exigentes del planeta. Al ofrecer el hardware de NVIDIA antes que nadie y con una integración tan profunda, Google se asegura de atraer a los talentos más brillantes y a las empresas más innovadoras. Para NVIDIA, la asociación con Google Cloud garantiza que sus innovaciones lleguen al mercado con la rapidez y la escala que solo un gigante de la nube puede proporcionar. Es una relación simbiótica donde el éxito de uno potencia directamente el éxito del otro, y donde el beneficiario final es el ecosistema tecnológico global.

La infraestructura de IA moderna requiere una visión holística que entienda que el procesador, la red y el almacenamiento son partes de un único organismo. NVIDIA y Google Cloud han demostrado entender esta realidad mejor que nadie. Su colaboración extendida proporciona la potencia, la flexibilidad y la seguridad que la era de la IA generativa demanda. A medida que las empresas comienzan a integrar estas nuevas capacidades en sus operaciones diarias, veremos una explosión de creatividad y eficiencia que redefinirá industrias enteras, impulsada por los motores de silicio de NVIDIA y el cielo digital de Google Cloud.

El compromiso con el código abierto y la interoperabilidad también se ve reforzado. A través del soporte para marcos de trabajo populares como TensorFlow, PyTorch y JAX, Google Cloud asegura que los modelos entrenados en hardware de NVIDIA sean portátiles y fáciles de gestionar. Esta apertura evita el bloqueo por parte del proveedor y fomenta una comunidad de desarrollo vibrante. La infraestructura está lista, las herramientas están disponibles y el potencial es ilimitado; estamos ante el comienzo de un capítulo fascinante en la evolución de la inteligencia artificial y la computación en la nube.